🐝 5 interesujących mnie kierunków: micro-LLM, text-to-3D-printing

Micro-LLM, Text-to-3D-printing i need for speed.

Drodzy,

[KOD: Bartek Majewski (założyciel Casbeg, angel investor w Eleven Labs, Restimo, Certifier) wydał ostatnio książkę 101 technik dla zarządzających na podstawie ponad 3,000 rozmów z menadżerami, więc dodając jeszcze doświadczenie Bartka to kaloryczność wiedzowa jest tu ponadprzeciętna. Z kodem STANUCH dla pierwszych 20 osób macie zniżkę 10 zł na papierowe wydanie do środy!]

Postęp i szum wokół wszystkiego co ma .ai czyni ten obszar dla mnie problematycznym: z jednej strony fascynuje, z drugiej przytłacza mnie w konfrontacji z ilością rzeczy, których nie wiem, nie rozumiem i jest powyżej mojego intellectual paygrade.

Dzielę się dziś kilkoma kierunkami, które mnie ostatnio interesują - trudno je nazywać niszami, untapped opportunities, bo nic dziś w AI nie jest niszą, może bardziej “obszarami intelektualnej stymulacji”, którym się przyglądam z zaciekawieniem.

🍓 1. Mikro modele na Raspberry Pi

🐝 2. Micro-LLM i edge computing, czyli drony, roje robotów i… Mars?

🖨 3. Text-to-3D-printing

💨 4. Groq, infrastruktura i need for speed

🤖 5. AI Agents (AutoGen, CrewAI)

Czas potrzebny na przeczytanie: 7 min 14 sekundy.

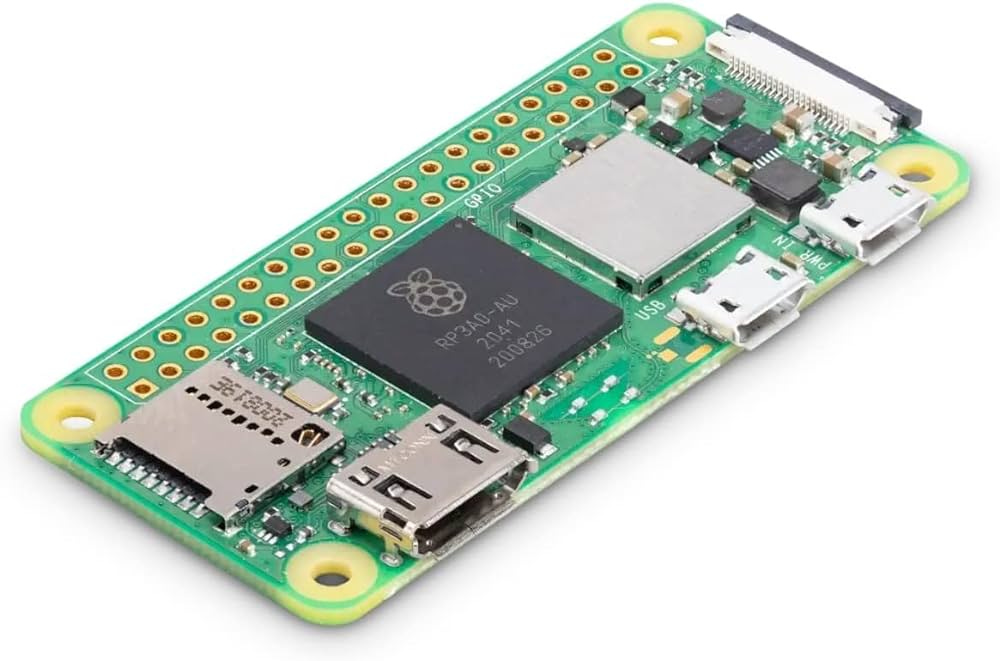

🍓 1. Mikro modele na Raspberry Pi

W llama2.c contributing guide Andrei Karpaty zawarł ciekawy fragment:

A few words on this repo and the kinds of PRs that are likely to be accepted. What is the goal of this repo? Basically I think there will be a lot of interest in training or finetuning custom micro-LLMs (think ~100M - ~1B params, but let's say up to ~10B params) across a large diversity of applications, and deploying them in edge-adjacent environments (think MCUs, phones, web browsers, laptops, etc.).

Dlaczego tak bardzo interesują mnie małe modele językowe, skoro mamy do dyspozycji Llama-3 70B, infrastrukturę, $0.5 / 1 mln tokenów i paradygmat “więcej = lepiej”?

Filozoficznie blisko jest to moim przemyśleniom z 5 notatek o atomach, bitach, 96kb i grze .kkrieger, czyli że nie jest sztuką odpalić Whisper na Mac Pro z 24‑rdzeniowym CPU, 76‑rdzeniowym GPU i 32‑rdzeniowym systemem Neural Engine za kilkadziesiąt tysięcy złotych.

Sztuką jest tak zooptymalizować oprogramowanie jak np. Whisper.cpp, żeby móc odpalić je… na telefonie.

Widzę potencjał w małych wyspecjalizowanych modelach, które mogą funkcjonować efektywnie na urządzeniach o ograniczonych zasobach, co stanowi równoległy krok w demokratyzacji innowacji: mniejsze wymagania sprzętowe, szybsze trenowanie, łatwiejsze dostosowanie do specyficznych potrzeb.

🐝 2. Micro-LLM i edge computing, czyli drony, roje robotów i… Mars?

Kontynuując ten wątek i use case’y patrzę na takie obszary:

Swarm robotics, czyli robotyka rojowa, gdzie szczególnie korzysta się z edge computingu. Roboty w roju komunikują się i współpracują, aby wykonywać zadania w sposób bardziej efektywny bez wymiany danych z centralą np. w ratownictwie mogą pracować wspólnie, co jest możliwe dzięki szybkiej obróbce danych “na krawędzi”. Taki mały robot nie ma pewnie możliwości udźwignięcia wielu procesorów, RAM i “czasu” na opóźnienia w komunikacji z API, więc roboty porozumiwające się ze sobą Bot-2-Bot z wykorzystaniem micro LLM może mieć tu zastosowanie.

Fajny case studentów, którzy zbudowali autonomicznego drona <$500, który pozycję kalkuluje na podstawie zrobionych kamerą zdjęć porównując z wgranymi zdjęciami z Google Maps bez użycia sygnału.

Grok, Tesla i autonomiczne auta. Jim Fan z NVIDIA zwrócił uwagę, że zainstalowany lokalnie model Grok-1.5 V będzie miał potencjał rozwiązywania przypadków krańcowych w autonomicznej jeździe bez konieczności kontaktowania się z centralą - szczególnie cenne w trudnych warunkach, gdzie liczą się milisekundy na podjęcie decyzji.

Gdy zabraknie sygnału na Marsie. Podróż na Księżyc to nawet trzy dni, podróż na Marsa zajmie ok. 6 miesięcy. Utrata sygnału z Ziemią jest nieunikniona (nie mówiąc już o latencji 5-20 min Ziemia - Marsem), dlatego zmniejszenie zależności od komunikacji naziemnej i wzbogacenie działań satelity czy urządzeń o lokalny LLM może mieć szczególne zastosowanie

[oczywiście, wydając miliardy na misję na Marsa możemy pewnie zbudować w rakiecie niemałe centrum danych, więc nie musi to być micro LLM].

🖨 3. Text-to-3D-printing

Generowanie modeli 3D na podstawie promptów (text/image-to-3D) rozwija się dosyć prężnie (Stable Dreamfusion, Point-E, GET3D, Text2Mesh, Magic3D, PIFuHD), by nie wspomnieć gigantów od Adobe po AutoCAD pracujących nad szeregiem narzędzi.

Piszę o tym, bo wciąż sądzę, że o druku 3D po fali hype’u lata temu mówi się dziś za mało w kontekście GenAI i nowych możliwości. Obietnica, że każdy będzie miał swoją drukarkę 3D raczej się nie spełniła (jeszcze?), ale w biznesie odbywa się chyba cicha rewolucja:

Today, 99% of hearing aids that fit into the ear are custom-made using 3D printing.

Jakiś czas temu dostałem pitchdeck startupu z USA: marketplace dla designerskiego obuwia drukowanego 3D (designerzy prezentują swoje projekty → zamawiasz → drukują).

Dlatego chętnie bym zobaczył dalszy rozwój - z wykorzystaniem tych gotowych modeli - rozwiązań text-to-3D. Podejrzewam, że wiele takowych już jest na wyciągnięcie ręki, a wyzwaniem jest teraz “posklejanie tego” i zagonienie “pod strzechy”.

Może “zaprojektuj mi zabawkę 3D do drukarki” przyśpieszy adopcję drukarek 3D?

💨 4. Groq, infrastruktura i need for speed

Groq oferuje infrastrukturę, na której możemy odpalić sobie opensource’owe modele jak Llama czy Mistral. Gdzie jest wyróżnik?

Prędkość.

Nawet do 500 tokenów / sekundę, dzięki wykorzystaniu LPU zamiast GPU. To ok. 100x szybciej niż przeciętna prędkość czytania, więc przy takim tempie rozmowa staje się już naturalna, nie mówiąc o zastosowaniach real-time (symultaniczne tłumaczenia, analiza treści, personalizacja etc.).

(Tomasz Kolinko ostatnio zaprezentował swój algorytm, który potencjalnie zwiększa 2-krotnie szybkość interferencji modeli LLM)

Pewnie przy 5,000 albo 50,000 tokenach / sekundę pojawią się nowe use case’y, natomiast na teraz widzę jaką innowacją może być po prostu sama szybkość, może nawet kosztem jakości.

Tu wracamy znów do manipulacji atomami, a nie (tylko) bitami.

🤖 5. AI Agents (AutoGen, CrewAI)

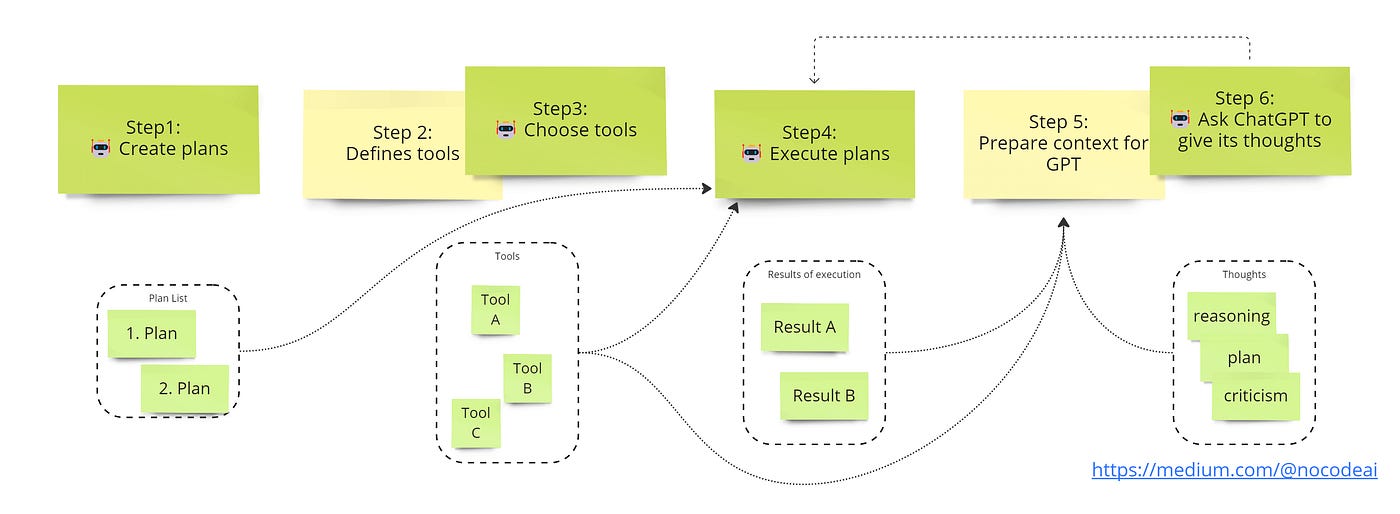

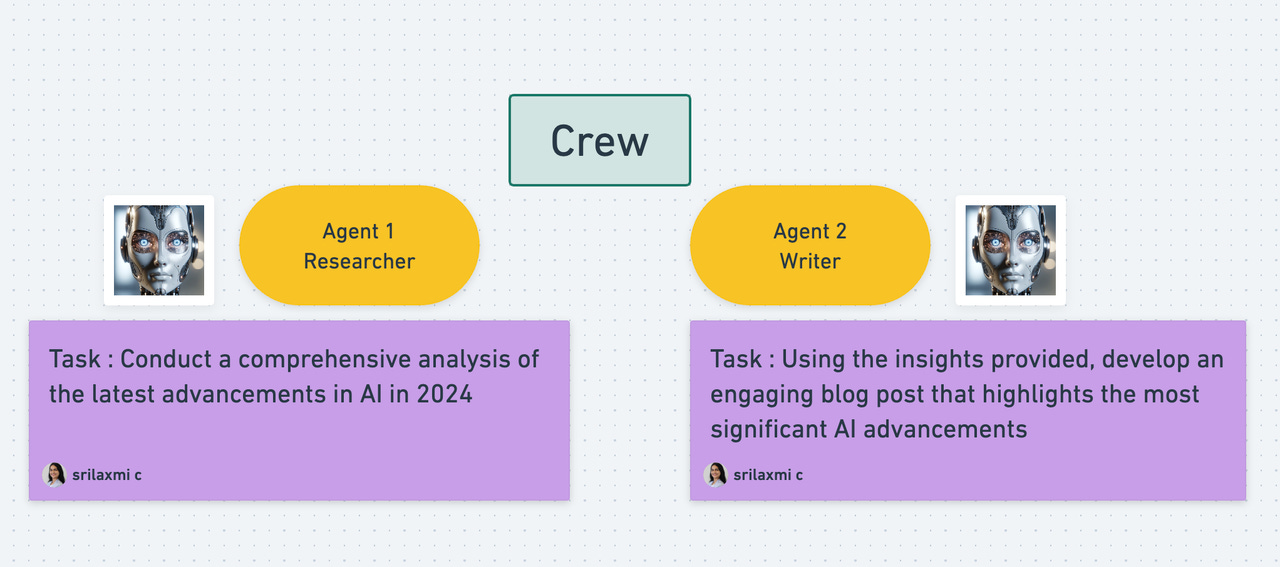

Zagadnienie AI agents nie jest czymś nowym, natomiast dopiero teraz przyglądam się nim bliżej i testuje różne frameworki jak AutoGen (Microsoft) czy CrewAI.

Dla przypomnienia: w tej chwili interakcja z modelami LLM opiera się na schemacie: wprowadzamy dane (prompt), model oblicza odpowiedź i za każdym razem chcąc uzyskać nowy wynik potrzebna jest akcja (kolejny prompt).

AI Agents działają w swoim zamierzeniu niezależnie tzn. podajemy cel / początkowy prompt i model sam generuje listę zadań i kroków w formie wewnętrznego monologu, które realizuje, aby osiągnąć swój cel. Przykład:

“Napisz mi serię 5 zooptymalizowanych pod SEO artykułów na temat wyboru karmy dla kota”

W idealnym scenariuszu AI agent mógłby wygenerować taki scenariusz działań:

(1) Analiza słów kluczowych

(2) Określenie tematów artykułów

(3) Tworzenie struktury artykułów

(4) Generowanie treści

(5) Optymalizacja i publikacja

Do każdego z tych kroków agent mógłby stworzyć lub użyć narzędzi np. (1) skorzystać z keyword search API do analizy słów kluczowych w Google. Dodatkowo, każdemu z tych kroków przypisany mógłby być osobny agent np. SEO Expert, który w punkcie (5) dokona jeszcze poprawek i optymalizacji tekstów przed publikacją.

Moje szybkie przemyślenia:

Dwa frameworki AutoGen i CrewAI są obiecujące (+ wizualny Autogen Node Editor) , natomiast wciąż jeszcze odpalanie agentów wymaga wielu testów, eksperymentów, konfiguracji (zapętla się albo dryfuje w nie tę stronę co trzeba); trochę jak lot statkiem z prędkością nadświetlną, gdzie odhylenie o 0.1 stopnia powoduje, że kończymy w innej galaktyce.

Nie jest to takie seamless (biorę tu korektę na moje niskie kompetencje) przez co moim zdaniem AI agents może być jeszcze czasem przerostem nad treścią (tu ciekawa perspektywa po zużyciu 500 milionów tokenów “You don’t need langchain. You probably don’t even need anything else OpenAI has released in their API in the last year. Just chat API. That’s it.” czy using langchain is useless)

…ale nie zmienia to faktu, że jeśli pozostaje niedosyt to jest i apetyt, więc dlatego automatyzacja w oparciu o komponent LLM z wykorzystaniem AI agents tak mnie ciekawi.

Wyobrażam sobie przyszłość z mikrokontrolerami za $20 komunikującymi się ze sobą za pomocą micro LLMów i podejmujących decyzje na podstawie danych z sensorów bez konieczności definiowania wszystkich if’ów.

Zostawiam na koniec z kilkoma linkami:

CrewAI Step-by-Step | Complete Course for Beginners [1:07:42] oraz CrewAI + Groq Tutorial: Crash Course for Beginners [32:09]

AutoGen Studio 2.0 Tutorial - Skills, Multi-Agent Teams, and REAL WORLD Use Cases (NO CODE) [15:10] oraz AUTOGEN STUDIO : The Complete GUIDE (Build AI AGENTS in minutes) [20:20] + AutoGen Studio: Build Self-Improving AI Agents With No-Code [27:05]

Miłej niedzieli,

Kamil

PS. Jak oceniasz dzisiejszy mail?

Co do 3D to powoli Etsy zapełnia się produktami w stylu kup gotowy plik i sam sobie wydrukuj. Czesciowo przez retrofitting i rozne upgrades jak np wkladka do trzymaczki kubkow w jakims aucie ktorej sie nie oplaca ani masowo produkowac ani kupowac na amazonie. Obecnie w miejscowych Merlin czy Komputronikach czesto sa promocje na drukarki 3D po $200.

Drugim kanalem sa drony, duzo ludzi ich kupilo a potem smigla uszkodzili czy pekla obudowa etc.